Professional Documents

Culture Documents

Red Backpropagation Rev. 0

Uploaded by

Marco A. Quispe PalaciosCopyright

Available Formats

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

Available Formats

Red Backpropagation Rev. 0

Uploaded by

Marco A. Quispe PalaciosCopyright:

Available Formats

ALGORITMO DE ENTRENAMIENTO RED BACKPROPAGATION

Paso 1. Inicializar los pesos de la red con valores pequeos aleatorios.

Paso 2. Presentar un patrn de entrada y especificar la salida deseada que debe generar la red.

Paso 3. Calcular la salida actual de la red. Para ello se presentan las entradas a la red y se

calcula la salida de cada capa hasta llegar a la capa de salida, sta ser la salida de la red.

Los pasos son los siguientes:

Se calculan las entradas netas para las neuronas ocultas procedentes de las neuronas de entrada.

Para una neurona j oculta:

en donde el ndice h se refiere a magnitudes de la capa oculta; el subndice p, al p-simo vector

de entrenamiento, y j a la j-sima neurona oculta. El trmino puede ser opcional, pues acta

como una entrada ms.

Se calculan las salidas de las neuronas ocultas:

Se realizan los mismos clculos para obtener las salidas de las neuronas de salida:

Paso 4 . Calcular los trminos de error para todas las neuronas.

Si la neurona k es una neurona de la capa de salida, el valor de la delta es:

La funcin f debe ser derivable. En general disponemos de dos formas de funcin de salida:

La seleccin de la funcin depende de la forma que se decida representar la salida:

si se desea que las neuronas de salida sean binarias, se utiliza la funcin sigmoidal,

en otros casos, la lineal.

Para una funcin lineal, tenemos:

,

Mientras, que la derivada de una funcin sigmoidal es:

por lo que los trminos de error para las neuronas de salida quedan:

Si la neurona j no es de salida, entonces la derivada parcial del error no puede ser evaluada

directamente, por tanto se obtiene el desarrollo a partir de valores que son conocidos y otros

que pueden ser evaluados.

La expresin obtenida en este caso es:

donde observamos que el error en las capas ocultas depende de todos los trminos de error de la

capa de salida. De aqu surge el trmino propagacin hacia atrs.

Paso 5. Actualizacin de los pesos: para ello utilizamos un algoritmo recursivo, comenzando

por las neuronas de salida y trabajando hacia atrs hasta llegar a la capa de entrada, ajustando

los pesos de la siguiente forma:

Para los pesos de las neuronas de la capa de salida:

Para los pesos de las neuronas de la capa oculta:

En ambos casos, para acelerar el proceso de aprendizaje se puede aadir un trmino momento.

Paso 6. El proceso se repite hasta que el trmino de error resulta aceptablemente pequeo para

cada uno de los patrones aprendidos[4][5].

Referencia Bibliogrfica:

Valencia, Marco; Yaez, Cornelio; Sanchez, Luis

Algoritmo Backpropagation para Redes Neuronales: Conceptos y Aplicaciones

[en linea]. 2006, [01 de Marzo de 2015], Disponible

<http://www.repositoriodigital.ipn.mx/bitstream/handle/123456789/8628/Archivo%20que

%20incluye%20portada,%20%C3%ADndice%20y%20texto.pdf?sequence=1 >

You might also like

- Ejercicio Tablas DinámicasDocument1 pageEjercicio Tablas DinámicasEmerson RamosNo ratings yet

- Examen Robotica 2Document1 pageExamen Robotica 2Marco A. Quispe PalaciosNo ratings yet

- Los Verbos en Inglés - PDF - SampleDocument55 pagesLos Verbos en Inglés - PDF - SampleJCarlos Lopez100% (12)

- 200 sustantivos en inglésDocument4 pages200 sustantivos en ingléstheopconalmailNo ratings yet

- Facultad de Ingeniería de Sistemas y ElectrónicaDocument4 pagesFacultad de Ingeniería de Sistemas y ElectrónicaMarco A. Quispe PalaciosNo ratings yet

- Base de DatosDocument2 pagesBase de DatosMarco A. Quispe PalaciosNo ratings yet

- Guia Practica para El Usuario 2013 UsersDocument324 pagesGuia Practica para El Usuario 2013 UsersJuan Antonio Gómez AguilarNo ratings yet

- ConversionDocument35 pagesConversionMarcoAntonioRojasNo ratings yet

- Plan Estudios 1011307Document6 pagesPlan Estudios 1011307Marco A. Quispe PalaciosNo ratings yet

- Sistemas Móviles de TelecomunicaciónDocument29 pagesSistemas Móviles de TelecomunicaciónCarlos GarzaNo ratings yet

- Constancia de Fase CulminadaDocument1 pageConstancia de Fase CulminadaMarco A. Quispe PalaciosNo ratings yet

- InstrupicDocument10 pagesInstrupicMarco A. Quispe PalaciosNo ratings yet

- CV MarcoantonioquispepalaciosDocument2 pagesCV MarcoantonioquispepalaciosMarco A. Quispe PalaciosNo ratings yet

- Capitulo 3. Bases Teoricas, Digitalizacion y Analisis de Imagenes PDFDocument6 pagesCapitulo 3. Bases Teoricas, Digitalizacion y Analisis de Imagenes PDFMarco A. Quispe PalaciosNo ratings yet

- Instrumentación Virtual Con LabVIEWDocument83 pagesInstrumentación Virtual Con LabVIEWSair Puello RuizNo ratings yet

- Sesión ArchivosDocument22 pagesSesión ArchivosMarco A. Quispe PalaciosNo ratings yet

- CompetenciasDocument1 pageCompetenciasMarco A. Quispe PalaciosNo ratings yet

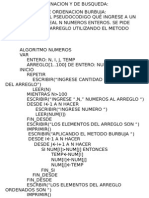

- Metodos de Ordenacion y de BusquedaDocument8 pagesMetodos de Ordenacion y de BusquedaMarco A. Quispe PalaciosNo ratings yet

- Sesion - 11 AlgoritmDocument5 pagesSesion - 11 AlgoritmMarco A. Quispe PalaciosNo ratings yet

- 03.1 Funciones Iniciales MARCODocument17 pages03.1 Funciones Iniciales MARCOMarco A. Quispe PalaciosNo ratings yet

- Oxford Learn - Cómo Unirse A Una Nueva ClaseDocument6 pagesOxford Learn - Cómo Unirse A Una Nueva ClaseMarco A. Quispe PalaciosNo ratings yet

- Sílabo - Programación Orientada A Objetos - C++Document1 pageSílabo - Programación Orientada A Objetos - C++Marco A. Quispe PalaciosNo ratings yet

- Boletin Junio Utp 11Document7 pagesBoletin Junio Utp 11Marco A. Quispe PalaciosNo ratings yet

- Ccna2 Version IV Capitulo 7Document23 pagesCcna2 Version IV Capitulo 7Marco A. Quispe PalaciosNo ratings yet

- Soluc ExP Alg A209 JuevesDocument5 pagesSoluc ExP Alg A209 JuevesMarco A. Quispe PalaciosNo ratings yet

- Sesión ArchivosDocument22 pagesSesión ArchivosMarco A. Quispe PalaciosNo ratings yet

- PC1 Lab LunesDocument1 pagePC1 Lab LunesMarco A. Quispe PalaciosNo ratings yet

- Sesion - 10-11 AlgoritmDocument20 pagesSesion - 10-11 AlgoritmJonny RnlNo ratings yet

- ALGORIMO1 PPSXDocument24 pagesALGORIMO1 PPSXMarco A. Quispe PalaciosNo ratings yet

- Metodos de Ordenacion y de BusquedaDocument16 pagesMetodos de Ordenacion y de BusquedaMarco A. Quispe PalaciosNo ratings yet

- Modelos probabilísticos teoría conjuntos espacios muestralesDocument7 pagesModelos probabilísticos teoría conjuntos espacios muestralesTibisay De Suárez SilvaNo ratings yet

- Ejercicios - Análisis Funcional de La ConductaDocument2 pagesEjercicios - Análisis Funcional de La ConductaIgor Ernesto Castro Kikuchi MontesNo ratings yet

- Ensayo Ing - EconomicaDocument6 pagesEnsayo Ing - Economicapedro Alejandro Rodríguez SantiagoNo ratings yet

- MRU y MRUV 2018Document5 pagesMRU y MRUV 2018andresNo ratings yet

- LogicoDocument8 pagesLogicoJairo Manuel Coveñas RamosNo ratings yet

- Tarea Del Primer Parcial Métodos NuméricosDocument5 pagesTarea Del Primer Parcial Métodos NuméricosRoberto Carlos Garces RodríguezNo ratings yet

- Ejercisios en C++Document20 pagesEjercisios en C++riacardo rockNo ratings yet

- Prueba Agosto 5toDocument7 pagesPrueba Agosto 5toRicardo BecerraNo ratings yet

- Ejercicio de Productividad Rev4a PDFDocument75 pagesEjercicio de Productividad Rev4a PDFHader Barrios Pastor100% (1)

- Clase 6 Elementos FinitosDocument73 pagesClase 6 Elementos FinitosJorGe IsRaelNo ratings yet

- Final de MatemáticaDocument8 pagesFinal de MatemáticaIvana AvalosNo ratings yet

- Nu Meros Racionales y Decimales OperacionesDocument38 pagesNu Meros Racionales y Decimales OperacionesVictoria Eugenia RendonNo ratings yet

- Configuraciones Basicas para Amplificadores Operacionales (Yoshua Stal)Document12 pagesConfiguraciones Basicas para Amplificadores Operacionales (Yoshua Stal)Yos StalNo ratings yet

- EJEMPLOSDocument16 pagesEJEMPLOSMax Edinson Mejia DextreNo ratings yet

- Cómo hablar con una máquina: introducción a la programación y los lenguajes de programaciónDocument65 pagesCómo hablar con una máquina: introducción a la programación y los lenguajes de programaciónAlejandro Hierro SantiagoNo ratings yet

- Taller CasiDocument10 pagesTaller CasiJessica Lazo BarreraNo ratings yet

- Uniad Derechos Del Niño NoviembreDocument14 pagesUniad Derechos Del Niño NoviembreHéctorSalomónQuirozOrtiz100% (6)

- Introduccion Pruebas de PozosDocument4 pagesIntroduccion Pruebas de Pozosmayaunik0% (1)

- Áreas y volúmenes de cuerpos geométricosDocument6 pagesÁreas y volúmenes de cuerpos geométricosIgnacio FloresNo ratings yet

- Guía Práctica #3 - LisbethDocument12 pagesGuía Práctica #3 - LisbethDennys Fabricio Encalada SoriaNo ratings yet

- Velocidad del sonido y resonancia en tubosDocument5 pagesVelocidad del sonido y resonancia en tubosdaniel torresNo ratings yet

- Trabajo 1 - Mecanica SolidosDocument8 pagesTrabajo 1 - Mecanica SolidosKevin Paul Aguilar ChamaNo ratings yet

- Plan de evaluación de matemática 1 en la Universidad de PortuguesaDocument2 pagesPlan de evaluación de matemática 1 en la Universidad de PortuguesaFreddy MatheusNo ratings yet

- Apuntes 292Document23 pagesApuntes 292Joaquín GonzálezNo ratings yet

- 3 - Tecnologia Del Sector CorteDocument11 pages3 - Tecnologia Del Sector CorteevachNo ratings yet

- Operaciones de Notación CientíficaDocument5 pagesOperaciones de Notación CientíficaCarito RubilarNo ratings yet

- Problemas M A S I-2012Document1 pageProblemas M A S I-2012Edgar GonzalezNo ratings yet

- ProblemasDocument19 pagesProblemascarlos ortizNo ratings yet

- Propuesta Didáctica para La Enseñanza de La Parábola en Ingeniería CivilDocument2 pagesPropuesta Didáctica para La Enseñanza de La Parábola en Ingeniería CivilMaría Del Pilar Moncaleano CasallasNo ratings yet